“AI 활용능력, HBM 용량이 좌우…메모리 강국 한국이 기술 주도해야”

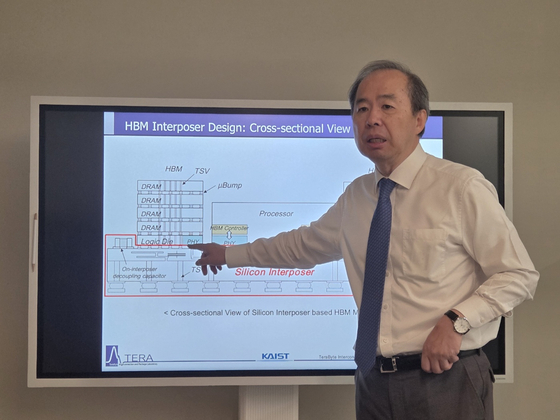

김정호 KAIST 전기및전자공학부 교수는 지난달 27일 중앙일보와의 인터뷰에서 향후 인공지능(AI) 반도체산업의 새 패러다임은 HBM 중심으로 펼쳐질 것이라며 이같이 말했다. ‘HBM의 아버지’라 불리는 김 교수는 HBM 관련 설계 기술을 20년 넘게 주도해왔다. 그가 이끄는 KAIST 테라랩에서는 박사후연구원을 포함한 석·박사 연구원 29명과 함께 차세대 HBM 기술 로드맵을 연구 중이며, 오는 11일 기술발표회를 개최할 예정이다. 김 교수는 “HBM을 메모리 강국인 한국이 주도해야 한다”고 말했다.

GPU 품귀 현상이 지속되고 있지만, 실제 구동되는 GPU는 10%만 일하는 역설적인 상황도 벌어지고 있다. 데이터 병목 현상 때문이다. 김 교수는 “GPU와 메모리 간의 데이터 전송속도가 AI 컴퓨팅의 핵심 병목이 되고, 이 때문에 GPU가 놀고 있는 동안 나머지 90%는 HBM이 바쁘게 읽고 쓰며 일하고 있는 것”이라고 설명했다. 이어 “생성 AI의 활용이 높아질수록 이런 현상은 더욱 심해질 것”이라며 “향후에는 HBM 용량에 따라 기업과 국가의 AI 실력이 좌우될 것”이라고 예측했다.

김 교수는 내년에 나올 HBM4부터 3년마다 차세대 제품이 개발돼 2038년에는 HBM8까지 나올 것이라면서 구체적인 세대별 로드맵을 제시했다. HBM7에는 D램 뿐 아니라 낸드플래시 메모리도 쌓아 올리는 고대역폭 플래시메모리(HBF)개념이 등장하는 등 세대별로 새로 추가되는 특징도 제시했다. 차세대 기술에서 가장 중요한 포인트로는 실리콘관통전극(TSV)과 냉각 기술을 꼽았다. HBM은 D램을 쌓아 TSV로 여러개의 미세한 구멍을 뚫어 데이터 연결통로를 맡기는 구조다. 현재 가장 최신제품인 HBM3E에는 이러한 구멍이 1024개인데 HBM4에는 2배 늘은 2048개가, HBM8에는 16배 늘은 1만6384개가 생길 것으로 예측했다. 김 교수는 “TSV의 중요성은 점점 커져 향후에는 HBM 면적의 40%까지 TSV가 될 것”이라며 “열 잡는 기술도 중요해 팬을 돌리는 것부터 시작해 반도체 내부에 물을 직접 통과시키게 될 것”이라고 말했다.

김 교수는 “기술을 선도하고 있는 HBM 분야에서 스펙의 주도권을 잡아서 가자는 의미에서 로드맵을 제시했다”며 “미국과 중국 사이에서 샌드위치 상황인 한국 반도체 산업이 HBM을 중심으로 돌파구를 찾아나가야 한다”고 강조했다.

박해리([email protected])

with the Korea JoongAng Daily

To write comments, please log in to one of the accounts.

Standards Board Policy (0/250자)