AI 챗봇 이젠 '표심'도 움직인다…"정치 광고보다 더 먹혀" [AI발 지각변동]

![생성 인공지능(AI) 챗봇이 정치 광고보다 유권자 설득에 더 효과적인 것으로 연구 결과 나타났다. 위 이미지는 AI를 이용해 생성한 것이다. [ImageFX]](https://www.koreadaily.com/data/photo/2025/12/05/c662f205-5c77-4492-93c2-c9a5743fd8c6.jpg)

인공지능(AI) 챗봇이 선거 유권자들의 ‘표심’을 움직이는데 정치 광고보다 더 효과적이라는 연구 결과가 나왔다. 미국 코넬대 데이비드 랜드 교수팀이 지난해 미 대선과 올해 폴란드 대선, 캐나다 총선에 앞서 진행한 대규모 실험을 통해서다. AI가 경제ㆍ산업뿐 아니라 정치에도 영향을 미칠 수 있음을 시사하는 대목이다. 일부에선 “AI 기술이 악용될 경우 민주주의 정당성에 대한 근본적인 위협이 될 수도 있다”는 우려도 나온다.

4일(현지시간) 학술지 ‘네이처’에 온라인 게재된 논문에 따르면, 연구팀은 각국 선거에 앞서 특정 후보를 옹호하도록 프로그램된 AI 챗봇을 만들었다. 미국의 경우 도널드 트럼프 당시 공화당 후보와 민주당 카멀라 해리스 후보, 캐나다에선 마크 카니 집권 자유당 대표와 피에르 포일리에브르 보수당 대표, 폴란드에선 중도 자유주의시민연합의 라팔 트르자스코프스키 후보와 우익 법과정의당의카롤 나브로츠키 후보를 지지하는 AI를 만든 것이다.

미국에선 멀티 에이전트(multi-agent) 시스템을 개발했고, 캐나다ㆍ폴란드에선 오픈AI의 GPT4.1, 딥시크의 V3-0324, 메타의 라마4-매버릭 같은 모델을 무작위로 사용했다.

![2024년 9월 미국 대통령 후보 TV토론에서 맞선 도널드 트럼프 당시 공화당 후보(왼쪽)와 카멀라 해리스 민주당 후보. [로이터=연합뉴스]](https://www.koreadaily.com/data/photo/2025/12/05/e9c6565b-5fec-4fa5-8c6c-9e8d793594fb.jpg)

━

챗봇이 후보자 선호도 높여…정치광고보다 효과적

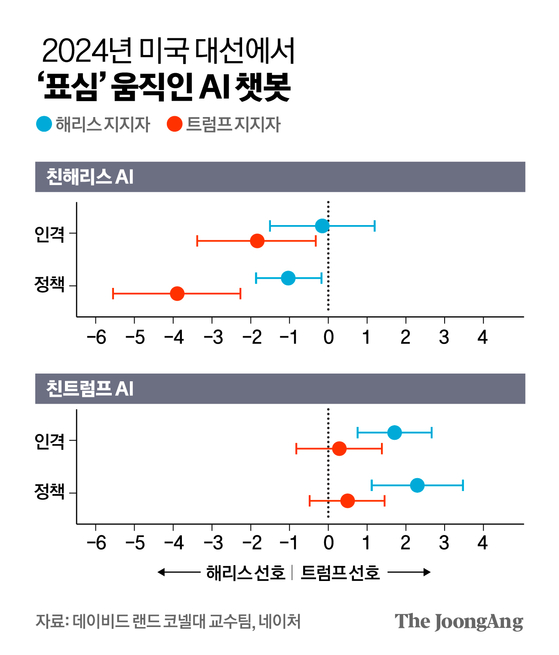

이렇게 AI가 총 2306명의 유권자와 대화를 나눈 뒤 후보자 선호도 변화를 분석한 결과, 친트럼프 혹은 친해리스 AI와 대화를 나눈 유권자는 각각 두 후보에 대한 선호도가 올라간 것으로 나타났다(평균 2.88포인트)

재미있는 것은 지지 후보별 유권자의 선호도 변화를 비교해 보니, 친트럼프 AI는 트럼프 지지자보다 해리스 지지자에게(2.30포인트), 친해리스 AI는 반대로 해리스 지지자보다 트럼프 지지자에게(3.90포인트) 더 효과가 있었다는 점이다. 즉, 두 AI 모두 자기편이 아닌 상대편을 더 성공적으로 설득했다는 것이다.

캐나다와 폴란드 실험에서 확인된 AI의 설득 효과는 더 커서, 미국 실험 결과의 거의 3배에 달했다.

연구자들은 이에 대해 “전통적인 정치 광고보다 AI와의 대화가 더 설득력 있다”는 분석을 내놨다. 실제로 지난 2016년 연구에 따르면 공화당 지지자가 민주당 광고를 봤을 때 설득 효과는 0.98포인트에 불과했다. 공화당 광고는 민주당 지자자에게 오히려 역효과(-0.65점)를 냈다.

━

‘분노 유발’보다 ‘증거와 사실’

AI는 어떻게 유권자들의 마음을 움직일 수 있었을까. 연구자들은 전문가 자료와 오픈AI의 o1을 이용해 27개 설득 전략을 짠 뒤, 챗봇 AI가 그 중 어떤 전략을 가장 많은 사용했는지 확인했다. 그 결과 예상과 달리 ‘스토리텔링’(0.09)이나 ‘분노 유발’(0.05) 같은 심리적 기법보다, ‘정중함과 시민성’(0.97) ‘증거와 사실 제시’(0.64) 같은 전략을 더 많이 쓰인 것으로 나타났다.

이는 ‘사람들은 자신의 정치적 신념과 반대되는 사실이나 증거를 접했을 때 이를 외면하거나 무시하는 경향이 강하다’는 정치심리학의 ‘정치적으로 동기화된 추론(politically motivated reasoning)’ 이론과 다른 결과다.

문제는 AI가 제시한 증거와 사실 중 일부가 부정확했다는 점이다. AI의 8134개 발언을 다른 AI(퍼플렉시티)와 정치적으로 중립적인 일반인 그룹을 통해 팩트체킹한 결과다. 가령 친트럼프 AI는 “세금 개혁과 일자리 증가로 트럼프 후보의 역량이 입증됐다”고 주장했지만, 오바마 대통령 재임 기간에 경제 성장이 계속됐다는 점은 무시했다. 친해리스 AI는 “해리스 후보가 의료, 인종 정의, 이민 문제에 일관성을 보여줬다”고 했지만, 실제 해리스는 이런 문제에 대한 입장을 바꾼 적이 있다.

연구팀은 특히 상대적으로 우파 정치인을 옹호하는 AI의 정확성이 더 떨어지는 것으로 나왔다며 “미국에서 우파에 의해 오보(misinfomation)이 더 많이 공유된다”는 과거 연구 사례를 인용했다. AI가 현실 세계의 문제점을 학습하고 그대로 재현하고 있음을 시사하는 대목이다.

━

설득력 높일 수록 ‘가짜 정보’ 늘어

같은 날 또다른 학술지 ‘사이언스’에 소개된 옥스퍼드대 팀의 연구 결과도 비슷했다. 영국에서 7만7000명의 참가자를 대상으로 707개 이슈에 대해 실험한 결과, AI 챗봇이 생성한 메시지의 정보 밀도(대화에 포함된 사실의 갯수)가 정치적 설득에 가장 큰 영향을 미치는 것으로 나타났다. 또 AI의 설득력을 강화할 수록 정보 부정확도가 올라가는 것으로 나타났다.

미국 퍼듀대 정치학과의 리사 아가일 교수는 ‘네이처’ 논평을 통해 “조작된 정보에 기초한 정치적 의사 결정은 민주적 거버넌스의 정당성에 대한 근본적인 위협”이라며 “연구자, 정책입안자, 시민 모두 정치에서 AI가 전파하는 잘못된 정보의 부정적 영향과 이에 대한 대책을 시급히 논의해야 한다”고 지적했다.

김한별([email protected])